In der Welt der Softwareentwicklung ist die reibungslose Bereitstellung und Skalierbarkeit von Anwendungen von entscheidender Bedeutung. Hier kommt DevOps ins Spiel, um die Lücke zwischen Entwicklungs- und Betriebsteams zu schließen. Aber selbst innerhalb von DevOps kann es eine Herausforderung sein, nahtlose Bereitstellungen zu erreichen und unerwartete Datenverkehrsspitzen zu bewältigen.

Hier kommt der Held dieser Geschichte ins Spiel: der Lastausgleicher. Diese raffinierte Technologie spielt eine entscheidende Rolle bei der Schaffung einer robusten und effizienten DevOps-Umgebung. Lassen Sie uns herausfinden, wie Lastverteiler arbeiten und warum sie für einen gut funktionierenden DevOps-Workflow unerlässlich sind.

Load Balancer verstehen: Der Verkehrspolizist

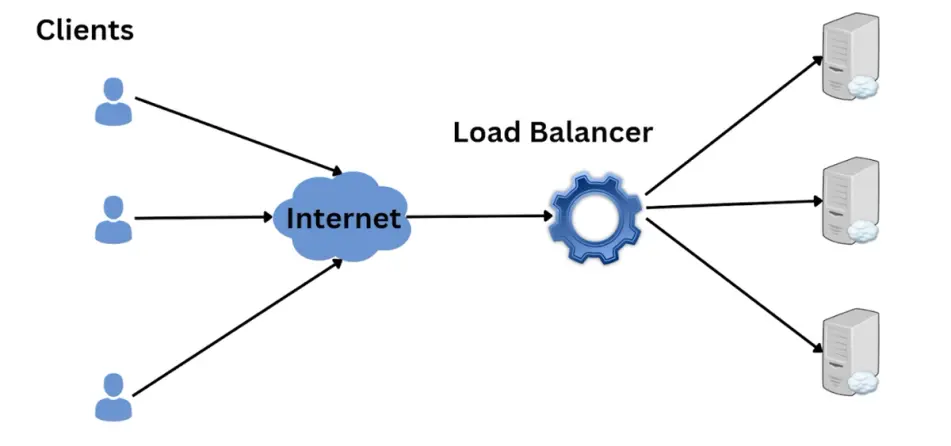

Ein Load Balancer agiert wie ein Verkehrspolizist, der vor Ihren Anwendungsservern sitzt und den eingehenden Datenverkehr zu den Servern lenkt. Wenn ein Benutzer den Zugriff auf Ihre Website oder Anwendung anfordert, nimmt der Load Balancer diese Anfrage entgegen. Er verteilt dann den Datenverkehr auf mehrere Server in Ihrer Infrastruktur und sorgt dafür, dass kein einzelner Server überlastet wird.

Diese Verteilung kann auf verschiedenen Faktoren basieren, z. B. dem Zustand des Servers, der Verarbeitungsleistung oder sogar der Art der Anfrage. Das Ziel ist es, die Leistung zu optimieren und ein nahtloses Benutzererlebnis zu gewährleisten.

Vorteile von Load Balancern in DevOps

Nachdem wir nun die grundlegenden Funktionen von Load Balancern verstanden haben, wollen wir nun untersuchen, wie sie speziell die DevOps-Umgebung verbessern:

- Automatisierte Einsätze: Stellen Sie sich vor, Sie stellen eine neue Version Ihrer Anwendung bereit. Traditionell würden Sie die Server einen nach dem anderen herunterfahren, sie aktualisieren und dann wieder in Betrieb nehmen. Dieser Prozess kann zeitaufwändig und störend sein. Mit einem Load Balancer können Sie die Bereitstellung automatisieren. Der Load Balancer leitet den Datenverkehr von den Servern weg, die aktualisiert werden, wodurch Ausfallzeiten minimiert werden und eine reibungslose Einführung gewährleistet ist.

- Skalierbarkeit leicht gemacht: Wenn Ihre Anwendung immer beliebter wird, kann der Anstieg des Datenverkehrs zu einem echten Problem werden. Das manuelle Hinzufügen von Servern zur Bewältigung der erhöhten Last ist mühsam. Mit einem Load Balancer wird die Skalierung mühelos. Sie können einfach neue Server zu Ihrer Infrastruktur hinzufügen. Der Load Balancer erkennt diese neuen Server automatisch und beginnt, den Datenverkehr entsprechend zu verteilen.

- Hohe Verfügbarkeit: Stellen Sie sich ein Szenario vor, in dem einer Ihrer Anwendungsserver ausfällt. Bei einer herkömmlichen Einrichtung könnte Ihre gesamte Anwendung ausfallen. Ein Load Balancer fungiert jedoch als zentrale Anlaufstelle. Wenn ein Server ausfällt, leitet der Load Balancer den Datenverkehr automatisch zu den verbleibenden gesunden Servern um und stellt so sicher, dass Ihre Anwendung für die Benutzer verfügbar bleibt.

- Bessere Nutzung der Ressourcen: Load Balancer bieten wertvolle Einblicke in die Serverleistung und Ressourcennutzung. Diese Daten helfen DevOps-Teams, potenzielle Engpässe zu erkennen und ihre Infrastruktur effektiv zu optimieren. Durch eine effizientere Nutzung der Ressourcen können Sie potenziell Kosten sparen und gleichzeitig eine optimale Anwendungsleistung sicherstellen.

- Vereinfachte Disaster Recovery: Load Balancer können für die Arbeit mit mehreren Rechenzentren oder Cloud-Umgebungen konfiguriert werden. Im Falle eines Ausfalls an einem Standort kann der Load Balancer den Datenverkehr nahtlos an den Backup-Standort weiterleiten, wodurch Ausfallzeiten und Datenverluste minimiert werden.

Verschiedene Arten von Lastverteilern

Es gibt zwei Haupttypen von Load Balancern, die häufig in DevOps-Umgebungen eingesetzt werden:

- Layer 4-Lastverteiler: Diese arbeiten auf der Netzwerkschicht (Layer 4) des OSI-Modells. Sie verteilen den Datenverkehr hauptsächlich anhand von Faktoren wie IP-Adressen und Ports. Layer 4 Load Balancer sind effizient und ideal für Szenarien mit hohem Datenaufkommen.

- Layer 7-Lastverteiler: Diese arbeiten auf der Anwendungsschicht (Layer 7) des OSI-Modells. Sie können intelligentere Entscheidungen über die Verteilung des Datenverkehrs auf der Grundlage von Faktoren wie URLs, Inhaltstyp und sogar Benutzer-Cookies treffen. Layer 7 Load Balancer bieten eine genauere Kontrolle, können aber einen etwas höheren Verarbeitungsaufwand haben.

Die Wahl zwischen diesen Typen hängt von Ihren spezifischen Anwendungsanforderungen und Verkehrsmustern ab.

Integration von Load Balancern in Ihren DevOps-Workflow

Im Folgenden finden Sie einige wichtige Überlegungen zur nahtlosen Integration von Load Balancern in Ihren DevOps-Workflow:

- Infrastruktur als Code (IaC): Verwenden Sie IaC-Tools wie Terraform oder Ansible, um die Bereitstellung und Konfiguration Ihres Load Balancer zusammen mit Ihren Anwendungsservern zu automatisieren. Dies gewährleistet Konsistenz und reduziert manuelle Konfigurationsfehler.

- Überwachung und Alarmierung: Richten Sie Überwachungstools ein, um die Leistung Ihrer Load Balancer und Anwendungsserver zu verfolgen. Implementieren Sie Warnmeldungen, um Ihr Team bei Problemen wie Serverausfällen oder Leistungsengpässen zu benachrichtigen.

- CI/CD Pipeline Integration: Integrieren Sie Ihre Load Balancer-Konfiguration in Ihre CI/CD-Pipeline. So können Sie Ihren Load Balancer als Teil Ihres Anwendungsbereitstellungsprozesses automatisch konfigurieren und aktualisieren.

Durch den Einsatz von Load Balancern können DevOps-Teams automatisierte Implementierungen, mühelose Skalierung, hohe Verfügbarkeit und optimierte Ressourcennutzung erreichen. Dies führt zu einer reibungsloseren Anwendungsbereitstellung, einer stabileren Infrastruktur und letztlich zu einem zufriedeneren Benutzererlebnis.

Mehr als nur die Grundlagen: Fortgeschrittene Techniken für den Lastausgleich

Wir haben uns zwar mit den Kernfunktionen von Load Balancern befasst, aber für diejenigen, die ihre DevOps-Umgebung weiter optimieren möchten, gibt es noch mehr zu entdecken:

- Gesundheitschecks: Konfigurieren Sie Ihren Load Balancer so, dass er regelmäßige Gesundheitschecks Ihrer Anwendungsserver durchführt. Dadurch wird sichergestellt, dass nur gesunde Server den Datenverkehr erhalten, so dass Benutzer nicht auf Fehler aufgrund von nicht funktionierenden Servern stoßen.

- Persistenz der Sitzung: Bestimmte Anwendungen erfordern, dass Benutzer während ihrer gesamten Interaktion eine Sitzung beibehalten. Load Balancer bieten Funktionen zur Sitzungsaufrechterhaltung, die sicherstellen, dass Benutzer während ihrer Sitzung mit demselben Server verbunden bleiben, selbst wenn der Load Balancer sie für andere Anfragen auf andere Server verteilt.

- SSL/TLS-Terminierung: Load Balancer können die SSL/TLS-Verschlüsselung und -Entschlüsselung übernehmen, wodurch diese Aufgabe von Ihren Anwendungsservern entlastet und die Gesamtleistung verbessert wird.

- Erweiterte Routing-Techniken: Moderne Load Balancer bieten fortschrittliche Routing-Techniken wie inhaltsbasiertes Routing oder pfadbasiertes Routing, so dass Sie mehr Kontrolle darüber haben, wie der Datenverkehr verteilt wird.

Durch die Erkundung dieser fortschrittlichen Funktionen können DevOps-Teams die Effizienz ihrer Infrastruktur und die Benutzerfreundlichkeit weiter verbessern.

Das letzte Wort: Der Einsatz von Load Balancern für eine robuste DevOps-Umgebung

Load Balancer sind ein unverzichtbares Werkzeug in der DevOps-Toolbox. Ihre Fähigkeit, Implementierungen zu automatisieren, die Skalierung zu vereinfachen und eine hohe Verfügbarkeit zu gewährleisten, rationalisiert den Prozess der Verwaltung des Lebenszyklus von Anwendungen. Durch die effektive Integration von Load Balancern können DevOps-Teams eine zuverlässigere und skalierbarere Infrastruktur schaffen, die letztendlich ein besseres Benutzererlebnis bietet.

Wenn Sie also das nächste Mal über DevOps nachdenken, denken Sie an den unbesungenen Helden – den Load Balancer. Er spielt eine entscheidende Rolle, wenn es darum geht, dass Ihre Anwendungen reibungslos und effizient laufen. So können Sie sich auf das Wesentliche konzentrieren – die Entwicklung und Bereitstellung außergewöhnlicher Software.